304永利集团官网入口-黄仁勋抢吃龙虾

首页财产ai正文 黄仁勋抢吃龙虾 北京时间今天凌晨两点,英伟达GTC年夜会召开,展示了新芯片与体系,先容了新技能,公布与多厂商互助鞭策AI成长,AI智能体迁移转变点已经至。 2026-03-17 08:16 ·呆板之心存眷AI的 AI投资人解读· 英伟达于GTC年夜会展示新产物,Vera Rubin架构的NVL72机能年夜幅晋升,每一瓦token机能晋升50倍。2025-2027年相干市场达1万亿美元,60%营业来自超年夜范围云计较。还有发布了全新AI推理芯片LPU和NemoClaw平台。· 行业竞争激烈,技能更新快;汽车制造商平台撑持度可能变化,影响主动驾驶营业拓展。总结:英伟达依附技能立异与产物上风,于AI范畴极具竞争力,但面对竞争与互助危害,建议连续存眷技能迭代与市场动态。内容由AI天生,仅供参考

老黄:科技公司的算力焦急,有 1 万亿刀那末年夜。

北京时间今天凌晨两点,英伟达 GTC 年夜会于加州圣何塞正式召开,这回的 Keynote 注定要被各至公司 CEO 不停援用了。

「咱们从头界说了计较,就像小我私家电脑革命及互联网革命同样。咱们此刻正处在一个全新平台厘革的初步。」英伟达结合开创人、CEO 黄仁勋说道。

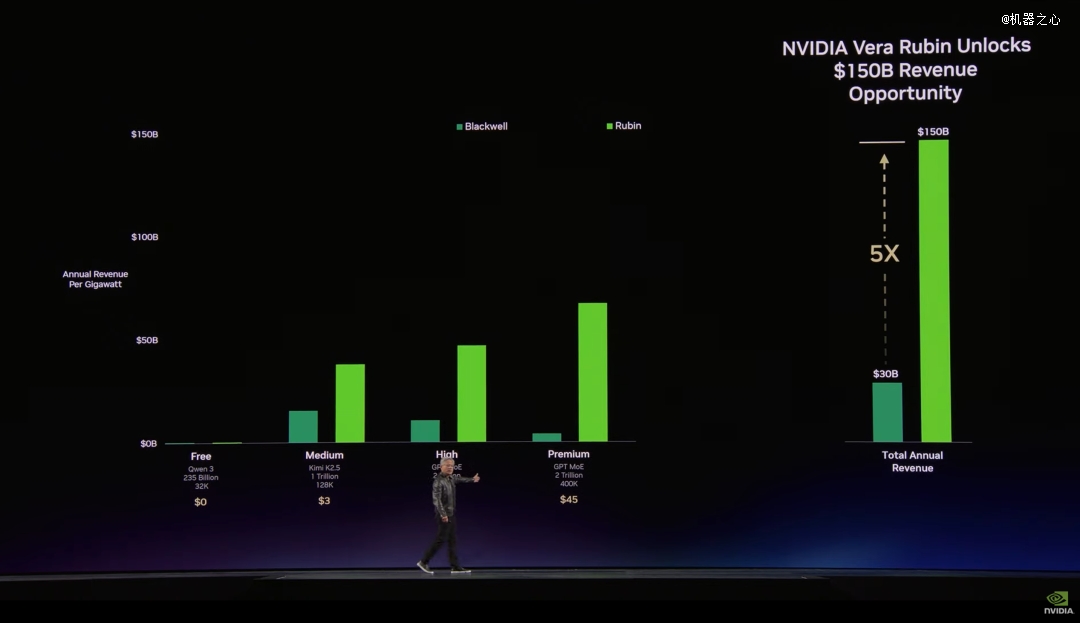

去年 10 月黄仁勋还有于暗示,他估计到 2026 年末的五个财季内,全世界公司于 Blackwell 及 Rubin 体系上的支出将到达 5000 亿美元。此刻他暗示,这一市场将于 2025 年至 2027 年间到达 1 万亿美元,60% 的营业未来自超年夜范围云计较。

数目直接翻倍,缘故原由于在 AI 到了「推理拐点」(The inference inflection)。假如说以前 AI 还有是于试验室里「疯狂练习」,那末此刻已经经周全进入了「推理及天生」阶段。算力的需求不是见顶了,而是方才发作。

「那末,这合理吗?」Keynote 剩下的年夜部门时间,黄仁勋都于会商这个问题。

新一代 Vera Rubin 量产,世界从未见过的芯片

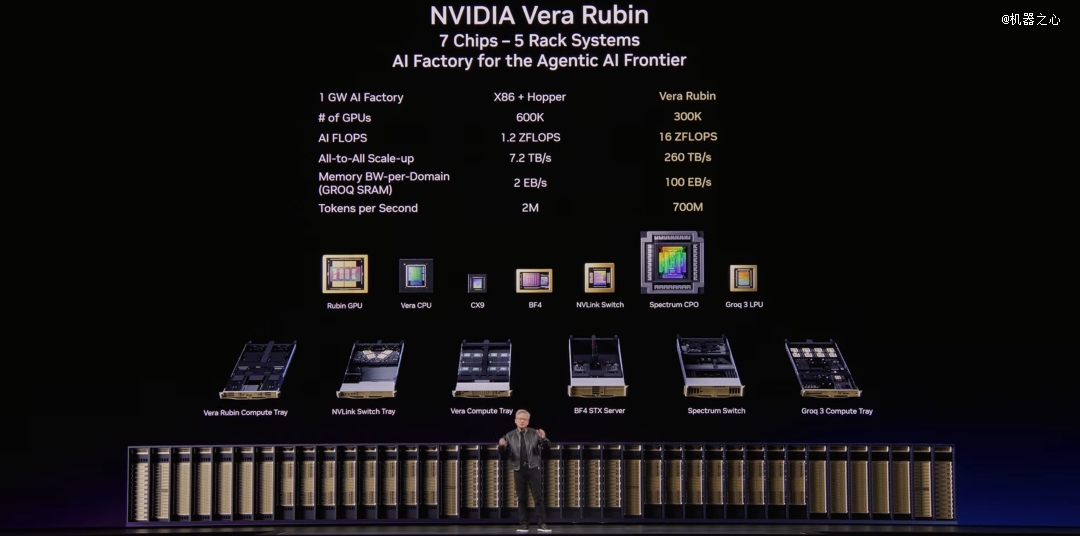

本年的新产物再也不是一块芯片,而是一个重大繁杂的 AI 算力体系。

黄仁勋暗示,基在全新 Vera Rubin 架构的英伟达 NVL72 是一场「豪赌」。于 AI 的推理使命上,要想把效率做到*面对着*的挑战。于互助伙伴的帮忙下,英伟达的努力获得了回报。

NVL72 架构的每一瓦 token 机能晋升了 50 倍,速率晋升远超摩尔定律。

这就是「token king」。

基在算力的晋升与 AI 技能的成长,数据中央已往是存储文件之处,此刻则酿成了天生 token 的工场。老黄指出,推理是事情负载,而 token 则是新的商品。

于 AI 的推理上,更繁杂的推理,以和更低的延迟将是算力需要解决的挑战。更高的效率也象征着企业更多的利润。

Vera Rubin NVL72 是「为智能体 AI 时代注入强盛动力的引擎」。老黄于台上展示了 Vera Rubin 的全套体系,这是一个重大而繁杂的体系,包罗七款全新芯片,旨于打造全世界*范围的 AI 工场,针对于 AI 各个阶段举行了优化,涵盖从预练习、后练习及测试时扩大到智能体推理的各个环节。

英伟达展示了 Vera Rubin 平台的细节,包括 Vera CPU、Rubin GPU、NVLink 6 互换机、NVIDIA ConnectX 9 超等网卡、BlueField4 DPU 及 Spectrum-6 以太网互换机,以和新集成的 Groq 3 LPU。

详细来讲,于 Vera Rubin NVL72 机架上集成为了 72 个 Rubin GPU 及 36 个 Vera CPU,它们经由过程 NVLink 6 毗连,并配备 ConnectX-9 SuperNIC 及 BlueField-4 DPU。Vera Rubin NVL72 实现了冲破性的效率 —— 与 NVIDIA Blackwell 平台比拟,前者利用四分之一数目的 GPU 便可练习年夜型混淆专家模子,每一瓦推理吞吐量提高了 10 倍,每一 token 成本仅为十分之一。

NVL72 专为超年夜范围 AI 工场而设计,可与 Quantum-X800 InfiniBand 及 Spectrum-X 以太网无缝扩大,从而于年夜范围 GPU 集群中连结高使用率,同时缩短练习时间及降低整体拥有成本。

还有有更年夜的核弹吗?有的兄弟,有的。它就是「NVIDIA Vera Rubin Ultra NVL576」,经由过程引入一种全新的双层全互连 NVLink 拓扑布局,使开发者可以或许将体系纵向扩大至至多 576 块 GPU。

Vera Rubin Ultra NVL576 将把 8 个自力的 MGX NVL 机架毗连于一路,每一个机架配备 72 块 Rubin Ultra GPU。所有机架经由过程铜缆互连及直连光互连配合构成一个同一的 576 GPU NVLink 域。

该体系将基在统一套 MGX 机架级生态构建而成,可以实现最快的量产落地周期。

为了验证这一跨机架的年夜范围 NVLink 拓扑架构, 英伟达内部构建一套功效完整、基在 GB200 的原型体系 ——Polyphe,以下图所示:

固然,最新的 Vera Rubin 算力也会部署到太空。

黄仁勋公布,英伟达正于研发名为 Nvidia Vera Rubin Space-1 的用在轨道数据中央的新型芯片 / 计较机,「太空中没有传导,没有对于流,只有辐射,咱们必需想措施于太空中冷却这些体系,但咱们有许多优异的工程师正于研究这个问题。」

英伟达暗示,比拟上代架构,Vera Rubin 的落地速率显著加速,今朝其已经于微软 Azure 上最先部署。跟着 Vera Rubin 的推出,AI 智能体的迁移转变点已经经到来,史上范围*的 AI 基建行将睁开。

全新 AI 推理芯片 LPU

Vera Rubin 强盛的能力,离不开 LPU(Language Processing Unit,语言处置惩罚单位)。

去年 12 月,英伟达斥资约 200 亿美元与 AI 推理芯片公司 Groq 告竣了一项战略生意业务,得到了 Groq 推理技能授权,收购其部门芯片资产,同时吸纳焦点团队成员,包括开创人 Jonathan Ross、总裁 Sunny Madra 等。

Groq 的价值于在,经由过程 LPU 专门优化的推理流水线与 GPU 协同计较,冲破纯 GPU AI 办事器于低延迟推理、token 解码效率及能耗上的瓶颈。

本次 GTC 年夜会上,NVIDIA Groq 3 LPX 的发布标记着加快计较范畴迎来了一项主要里程碑。

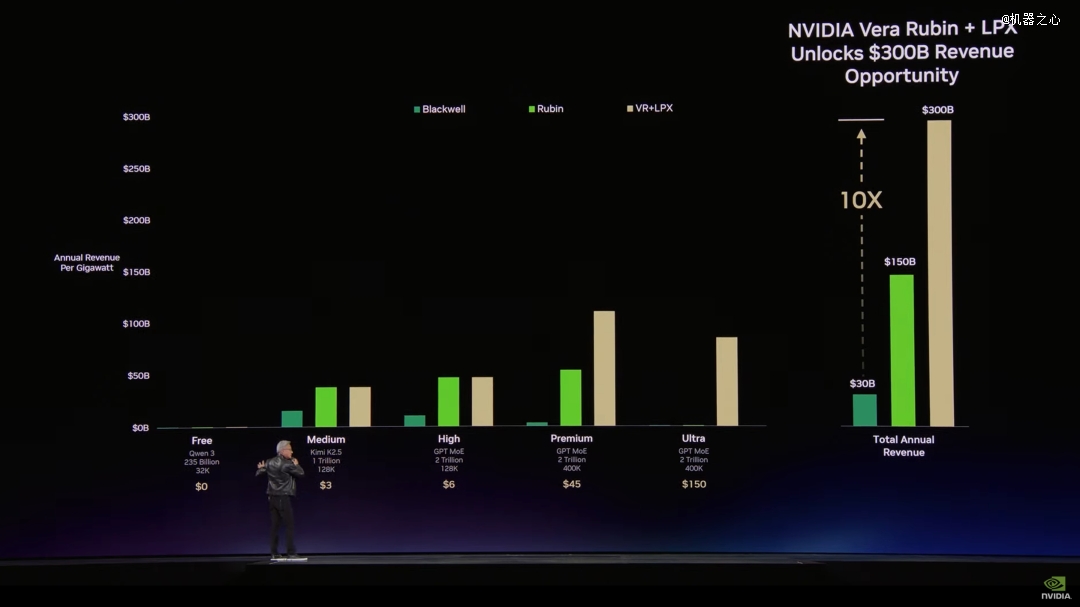

年夜模子推理持久面对一个焦点抵牾:低延迟与高吞吐量往往难以兼患上。而 Groq LPX 架构与 Vera Rubin GPU 协同事情,专门针对于智能系统统所需的低延迟与超长上下文推理举行优化。

于这一架构下,每一兆瓦推理吞吐量最高可晋升 35 倍,并为万亿参数模子带来最高 10 倍的营收潜力。

更高的每一瓦吞吐量及 token 级机能,将开启一个新的推理层级,使患上万亿参数、百万上下文的超高端模子推理成为可能,并为所有 AI 办事提供商带来更年夜的贸易空间。

于设计上,LPX 机架采用全液冷设计,基在 MGX 基础举措措施构建,可无缝集成到下一代 Vera Rubin AI 工场中。

同时,LPX 机架包罗了 256 个 LPU 处置惩罚器,提供 128GB 片上 SRAM 及 640 TB/s 的纵向互联带宽。

于年夜范围部署时,年夜量 LPU 可以协同事情,像一个巨型单一处置惩罚器同样运行,实现高速、确定性的推理加快。

当与 Vera Rubin NVL72 体系一同部署时,Rubin GPU 与 LPU 会协同计较 AI 模子每一一层的每一个输出 token,显著晋升解码机能。

LPX 架构针对于万亿参数模子与百万 token 上下文举行了优化,经由过程与 Vera Rubin 的协同设计,于功耗、内存与计较效率之间实现*均衡。

今朝,LPU 是由三星代工出产,将来的新一代可能会由台积电代工。别的于将来的 GPU(Feynman 架构)上,也可能整合 Groq 处置惩罚器,这有望于晋升机能的同时降低成本。

Nvidia Groq 3 LPX 估计将于本年下半年正式推出。

NemoClaw:英伟达版 OpenClaw 上线

近来科技圈最火的观点是 OpenClaw,老黄于 GTC 上把它比作「操作体系」,简朴来讲,OpenClaw 是一个可以毗连到云体系的智能体平台。它可以天生其他智能体、举行调理、分化问题等等。

然而,当前基在 OpenClaw 的 AI 智能体于与外部通讯时存于安全隐患。而英伟达推出的 NemoClaw 具备企业级安全保障,有助在掩护敏感信息。

英伟达经由过程于 OpenClaw 开创人 Peter Steinberger 构建的基础架构之上添加多层安全防护,乐成地将 OpenClaw 定位为企业级安全解决方案。老黄称,英伟达招集了「全世界*的安全研究职员,对于 OpenClaw 举行了修改,使其可以或许安全地部署于企业内部。」

他同时夸大,如今每一一家企业都需要制订本身的 OpenClaw 战略。于黄仁勋看来,OpenClaw 以和更广义的 Claw 体系,将来的主要性将与 Linux、Kubernetes、HTML 等基础软件举措措施相提并论。

于详细技能层面,NemoClaw 就是一套让 OpenClaw 更易部署、也更安全运行的基础软件东西。经由过程 NVIDIA Agent Toolkit,用户只需一条号令就能完成 OpenClaw 的安装及优化,同时主动部署 OpenShell 运行时。

这个运行时提供开源模子撑持及断绝的沙箱情况,让 AI 智能体于履行使命、挪用东西或者拜候外部收集时,依然可以或许遭到安全、收集及隐私计谋的约束。

NemoClaw 同时撑持多种 coding agent。于开放智能体模式下,它可以挪用运行于用户当地专用体系上的开源模子,包括 NVIDIA Nemotron;同时经由过程隐私路由(privacy router),智能体也能够拜候运行于云真个前沿模子。

当地模子与云端模子的联合,为智能体连续进修与能力扩大提供了基础,使其可以或许于既定的隐私与安全法则下完成更繁杂的使命。

黄仁勋还有提到,与 OpenClaw 搭配部署的*模子之一,是英伟达近来发布的 Nemotron 3 Super。这是一款面向智能体(agentic)场景的开源年夜语言模子。

Nemotron 3 Super 专门针对于长上下文使命举行了优化,同时模子范围节制于 1200 亿参数。联合 NemoClaw 提供的安全层以和 Nemotron 3 Super 自己具有的隐私上风,英伟达基本解决了边沿部署智能体时最要害的隐私限定问题。

除了此以外,NemoClaw 还有可以挪用英伟达生态中的多种开源东西及框架,例如 cuDF、Nemotron Dynamo、cuOPT 等库。这些组件为智能体提供了更多能力,使其于处置惩罚数据、优化决议计划及履行繁杂使命时越发高效及强盛。

从今天起,开发者可以经由过程如下链接拜候英伟达的 Agent Toolkit 及 OpenShell,也能够将 OpenShell 与 LangChain 联合利用,或者者直接从 GitHub 下载并于当地运行。

链接地址:https://build.nvidia.com/

企业用户则可以经由过程 AWS、Google Cloud、Microsoft Azure 等云办事平台创立并部署 AI 智能体。

AI 进入物理世界

数字世界的智能体以外,AI 也正于物理世界年夜范围落地。

英伟达于 GTC 年夜会上展示了 110 台呆板人,比亚迪、现代、日产及吉祥成了英伟达最新互助伙伴,这些车企公布将采用 NVIDIA DRIVE Hyperion 技能打造 L4 级主动驾驶汽车。

于愈来愈多的汽车制造商平台的撑持下,英伟达及 Uber 规划于 2028 年于四年夜洲的 28 个都会推出彻底由 NVIDIA DRIVE AV 全栈软件驱动的主动驾驶车队。估计到 2027 年上半年,Uber 的主动驾驶将会于洛杉矶及旧金山湾区率先推出。这支由 DRIVE Hyperion 提供撑持的车队将使用 NVIDIA Alpamayo 开放模子及 NVIDIA Halos 操作体系。

于 GTC 年夜会上, 英伟达公布与年夜量呆板人厂商互助,配合鞭策出产范围的物理 AI 成长。英伟达发布了全新的 NVIDIA Isaac 仿真框架以和面向业界的全新 Cosmos、Isaac GR00T 开放模子,用在开发、练习及部署下一代智能呆板人。

开放式物理 AI 数据工场 Blueprint 则旨于对于视觉 AI 智能体、呆板人及主动驾驶车辆的物理 AI 模子举行年夜范围数据处置惩罚及治理、合成数据天生、强化进修及评估。

Keynote 末了上场的脚色,是于虚拟世界中练习,得到物理躯体的「雪宝」呆板人,它是彻底由英伟达物理 AI 全家桶构建出来的。也许不久以后咱们会于迪士尼乐土里看到他。

AI 的下半场才方才最先,你预备好上车了吗?

参考链接:

https://www.youtube.com/watch?v=jw_o0xr8MWU

https://nvidianews.nvidia.com/news/nvidia-vera-rubin-platform?ncid=no-ncid

【本文由投资界互助伙伴呆板之心授权发布,本平台仅提供信息存储办事。】若有任何疑难,请接洽(editor@zero2ipo.com.cn)投资界处置惩罚。

-304永利集团官网入口